#410 enero de 2026

Retrospectiva 2025 Neste episódio fazemos uma retrospectiva dos assuntos mais importantes tratados em 2025 no Segurança Legal. Você irá descobrirá os principais temas que dominaram o ano em inteligência artificial, segurança da informação e direito digital. O episódio traz uma análise sobre o aparecimento do Deepseek, explorando como a inteligência artificial transformou o cenário de segurança cibernética. Você irá descobrir os riscos de atrofia cognitiva causados pelo uso excessivo de IA, a importância da proteção de dados pessoais com a LGPD, e como os backdoors em modelos de linguagem ameaçaram a supply chain. O podcast também aborda questões de vigilância digital, as novas regras do Banco Central após fraudes bancárias, a inconstitucionalidade do artigo 19 do Marco Civil, a aprovação do ECA Digital, vulnerabilidades no gov.br e a questão crítica do analfabetismo funcional digital. Esta retrospectiva cobre ainda aspectos geopolíticos da IA, regulação de inteligência artificial, conformidade com políticas de proteção de dados, e o papel das bigtechs em 2025.

Esta descrição foi realizada a partir do áudio do podcast com o uso de IA, com revisão humana.

Visite nossa campanha de financiamento coletivo e nos apoie!

Conheça o Blog da BrownPipe Consultoria e se inscreva no nosso mailing

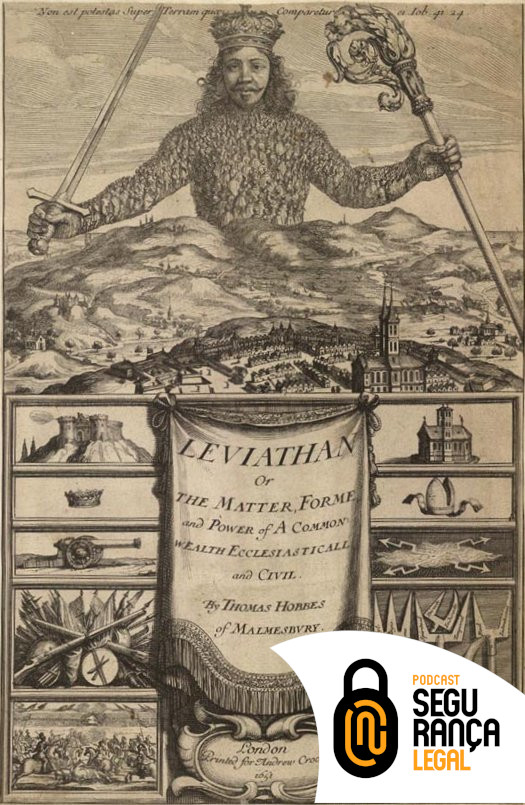

Imagem do Episódio – Por trás do tempo – Guilherme Goulart

📝 Transcrição do Episódio

(00:06) Bem-vindos e bem-vindas ao episódio especial de retrospectiva do Segurança Legal. Eu sou o Guilherme Goulart e aqui comigo está o meu amigo Vinícius Serafim. E aí, Vinícius, tudo bem? >> Olá, Guilherme, tudo bem? Olá, aos nossos ouvintes. >> Bom ano novo para você e para os ouvintes também. >> Valeu, cara.

(00:23) Muito obrigado para ti também, para os nossos ouvintes. Um maravilhoso 2026 cheio de surpresas que virão, né? Na verdade, ele já começou com algumas surpresas bem interessantes, né? >> É, já começou com várias surpresas interessantes e importantes, aí, né? Bom, eh, sempre lembrando, né, que para nós é fundamental a participação de todos com perguntas, críticas e sugestões de tema.

(00:44) Então vocês já sabem, estamos à disposição pelo e-mail podcast@segurançalegal.com, YouTube, onde você pode ver esta transmissão, se é que já não está vendo no YouTube, Mastodon, Bluesky, Instagram e TikTok. Eventualmente alguns cortes dos episódios vão também para TikTok e para o próprio YouTube. O YouTube tem priorizado muitas vezes os vídeos shorts que ele chama, acho que é, né? Então você também encontrará alguns shorts lá no nosso YouTube.

(01:12) Bom, a ideia, né, é que as retrospectivas geralmente são feitas no finalzinho do ano, né, de 2025, mas a gente, né, por questões de um mini descanso que fizemos no final do ano, vem agora a retrospectiva, porque não tem problema, né? Não há problemas. Então, a gente vai fazer uma revisita aos temas mais importantes, os grupos de temas na verdade mais importantes aqui de 2025, que foram os episódios 384 a 408, então foram 25 episódios aqui, né.

(01:49) >> Muita inteligência artificial, mas também bastante segurança, né, e aspectos jurídicos, como a gente vai ver aí na nossa retrospectiva, sem se esquecer, Vinícius, que você também pode, se quiser, e a gente conclama que você faça, apoiar o Segurança Legal pela nossa campanha de financiamento coletivo lá no Apoia.se.

(02:09) Apoia.se/segurançalegal do Segurança Legal, você estará ajudando a manter um projeto independente de produção de conteúdo de proteção. Então, já começamos direto, Vinícius, no tema que dominou o ano. Esse tema é muito impressionante, tem muitas características e uma das características desse tema é que ele funciona quase como um buraco negro. Ele vai atraindo a atenção das pessoas de uma forma quase que mágica, às vezes, né? Bom, vocês já sabem, a inteligência artificial. E uma coisa que eu vou destacar, o primeiro item aqui, já te passo a bola, é o momento Sputnik e o nascimento, ou não sei se é bem o nascimento ali, né, mas o aparecimento do Deepseek lá em janeiro de 2025.

(03:02) E é interessante a gente notar o ano, né? Bem no início do ano. >> Bem no início. Um dos primeiros ali. Cara, parece que faz muito mais tempo, né? >> Sim. >> E não faz um ano. >> E não faz um ano. E quando a gente fala disso, e aliás, vai fazer um ano amanhã, pelo o episódio é o 385 de, ah, não, 6 de fevereiro, né? É, é, >> é o que chama a atenção aí.

(03:26) Bom, primeiro que sim, essas aplicações acessíveis ao grande público, né, desde 2022 para cá tem sido inaugurado com ChatGPT. Realmente, cara, 22 parece que faz muito tempo em termos de soluções e de quanto melhorou a gente sabe no nosso dia a dia. É uma coisa realmente absurda. A gente usa desde o dia zero lá em 22, a gente tem utilizado e acompanhado e o Deepseek em si, por si só, né, o modelo em si, é interessante e tal. Eu não uso, tá? Eu fiz alguns testes naquela época, depois não acompanhei mais. Eu tenho uma certa preferência pelos modelos da Anthropic.

(04:23) Mas o que chamou bastante atenção foi que o Deepseek conseguiu com uma fração do custo da OpenAI, que era na época 100 milhões de dólares que ela gastou para fazer o GPT4, estimado porque ela não abre esse valor exato, tá? Enquanto a OpenAI teria gasto aí mais de 100 milhões para treinar o GPT4, o pessoal do Deepseek, né, conseguiu fazer com 5,5 milhões de dólares, tá?

(04:48) >> E ainda por cima, utilizando os chips da Nvidia que não estavam sob embargo, tá? Uhum. >> Porque os chips H100, os mais avançados, os H200 e tal, agora H200, ã, mas esses chips estavam embargados e continuam, né? Algumas coisas ainda não podem ser vendidas para a China.

(05:09) O governo chinês, o pessoal na China já está revoltado. Isso é uma atualização, tá? Eles estão cada vez mais tentando treinar com alternativas, tipo Dansé, não vão ficar dependendo de uma empresa que pode ora vender, ora não vender. E então assim, tem coisas que já estão fora do embargo e não estão sendo compradas como se esperava, tá? E isso, naquela confusão toda do modelo precisar muito menos recurso para ser treinado.

(05:39) Ah, num dia a Nvidia perdeu 600 bilhões de dólares de valor, porque assim, meu Deus do céu, então a gente não vai precisar de tanta coisa, né, o mercado enlouqueceu assim, não. Então, para isso, os caras fizeram com uma fração dos recursos. A Nvidia não vai vender tanto assim, então as ações da Nvidia despencaram e tal, mas depois ao longo do ano a Nvidia voltou a subir e tal, vai precisar de GPUs da Nvidia de qualquer jeito.

(06:00) >> Então não vai ter >> não, não vai ter mais saída nesse sentido. >> Isso destaca esse aspecto econômico, né? Eh, e geopolítico também, né? O nome sugere Sputnik da coisa da corrida espacial, né, entre os Estados Unidos e na época União Soviética e tal. >> E a gente está vendo hoje, né, essa uma reconfiguração política e geopolítica.

(06:24) E a IA está no cerne disso, né, com o governo Trump. E >> e eu acho que a gente começou bem o ano ali, porque isso meio que ditou muito da geopolítica global, né? Não somente isso. Agora a questão do petróleo, Venezuela e tal, mas a inteligência artificial. Quer dizer, até isso, né? Tecnologia de maneira geral, né? É a tecnologia de maneira geral, né? >> Mas o papel das terras raras para a produção de chips é interesse dos Estados Unidos também, né? Então, sim, sim, sim.

(06:52) >> Essa corrida está bem, está ficando cada vez mais estranha, né? >> Bom, depois, Vinícius, a gente segue com outras análises aqui envolvendo inteligência artificial. A gente falou sobre IA e pensamento crítico, que é um baita tema também. E quando a gente começa a envolver educação, né, não somente educação, mas a forma como as pessoas vão passar a usar. Ninguém sabe direito ainda quais são os impactos da IA no psicológico das pessoas e também na forma como elas vão aprender, né?

(07:11) Tem diversas formas aí de você se beneficiar delas, mas também a gente sabe que, sendo utilizada de uma forma errada ou sem saber exatamente como utilizar, ela pode trazer uma série de malefícios. E um desses malefícios é a redução do pensamento crítico. Num estudo que ficou bem famoso ali da Microsoft, “The Impact of Generative AI on Critical Thinking”. Vou ler só esse pedaço aqui porque o título é muito grande, né?

(07:33) Eh, e basicamente a gente falou sobre isso lá no episódio 387. Ou seja, quanto mais tu usa, quanto mais tu confia, menos o teu pensamento crítico vai ser habilitado… (07:57) Eh, e isso é crucial no âmbito da educação. E também a gente aprofundou um pouco isso lá no 406, com estudos, né, um outro artigo, mas que >> falava sobre aquela ideia de atrofia cognitiva. Ou seja, quanto mais o sujeito vai usando, mais ele vai perdendo certas capacidades. E essas capacidades ficam naquela ideia de dívida cognitiva acumulada, né? Você para de usar IA e demora para retornar àquilo, né?

(08:34) Mas sabe que a gente não sabe, né? É pouco tempo ainda para a gente estudar os impactos disso, né? Até da própria internet muitas vezes a gente não sabe direito os impactos na educação. Então agora, com a IA isso fica bem mexido também. É, esse segundo artigo no episódio 406 é aquele episódio que tem 206 páginas, tá? Foi utilizado eletroencefalograma e tal. Ele é bem mais completo do que o estudo da Microsoft que a gente falou no 387, mas ambos chamam atenção para esse perigo, né?

(09:09) Esse perigo não é que toda tecnologia tem risco, né, Guilherme? >> Uhum. >> Toda tecnologia tem, a gente começa a se acostumar com ela ali, a gente vai mudando o nosso comportamento e aqui a gente está mudando, falando de mudança de comportamento cognitivo, né? Hum. >> Então, é um problema que a gente tem que estar ligado, principalmente com relação à educação de crianças, né, o processo de educação e tudo mais. É.

(09:34) >> Ah, e aí fala, Guilherme. >> Não, não. Eu ia, eu ia dizer já passando para o próximo, até porque são muitas coisas, né? >> É, não, só tem um ponto aqui que é o seguinte. Teve um estudo na Nature depois, tá? Que se mostrou que aumentava o comportamento desonesto de 84 a 88% das vezes, né, de pessoas que podiam simplesmente delegar a demanda para IA.

(10:09) Então assim, se eu puder delegar para IA, aumenta substancialmente, tá? Segundo esse artigo publicado na Nature, o artigo é de 23, tá? O estudo foi feito em 23. Ele aumenta substancialmente a chance de alguém agir de forma desonesta, tá? Então tá aí 387, 406, tá? A gente não vai entrar em cada um dos temas aí que senão a coisa fica longa demais.

(10:32) >> Bom, 2025 também foi o ano de segurança e inteligência artificial. Esse tema teve, dominou não, mas teve com uma frequência grande aqui no Segurança Legal. Eu acredito, essa é uma retrospectiva, mas eu não vou me furtar de fazer algumas projeções, mas isso é bem óbvio, né? Vai ser um tema que aí sim 2026 acho que vai entrar muito mais forte. Ou seja, quando mais pessoas estiverem usando, mais incidentes, problemas, riscos vão começar a aparecer e necessariamente as empresas vão

(11:05) ter que, ou não, porque até para a segurança hoje a gente sabe como é difícil convencer as empresas em alguns casos a investir, mas a gente sabe que 2025 teve uma série de questões. Teve um experimento do Chancar Vinícius sobre backdoors em LLMs e tal. Fala um pouco para a gente aí o que a gente comentou nesses episódios.

(11:27) >> Rapidamente, a ideia que se testou foi tu ter um modelo que foi previamente instruído a gerar código, inserir backdoors nesses códigos, tá? >> E obviamente o modelo fez. Claro que a gente não está falando aí de modelos na mainstream, né? A gente não está falando de um Chat, um GPT5, um GPT4, um Sonet, um Opus, etc.

(11:53) Eh, mas de eventualmente, assim, se você vai lá falar no Hugging Face, a gente tem dezenas de milhares de modelos e assim, ah, vou pegar um modelo, vou puxar aqui, vou executar na minha máquina, vou fazer um produto em cima disso. Você tem que saber o que tem nesse modelo, tá? Então, se você já tem gente que desconfia dos modelos da Open, por exemplo, né, tem que tomar cuidado com mais ainda com modelos, entre aspas, quaisquer que você vai lá e busca na internet e sai executando. Se não você não sabe o que

(12:22) tem nele, tá, em geral. Então, muito cuidado. Consegue saber olhando para o modelo, né? >> Não, nem consegue saber olhando para o modelo. Então, assim, é bem delicado isso, tá? Eh, porque o que o Shankar mostrou é que é possível instruir um modelo para injetar backdoors, né, portas dos fundos ou outras formas de acesso alternativas em sistemas que foram gerados utilizando aquele modelo e que o quem estava usando o modelo para desenvolver não solicitou aquilo, tá?

(12:52) >> Uhum. >> Muito cuidado. Supply aqui é um baita de um pepino, tá? E aí no 399, a gente tem três episódios aqui, o 386 que a gente falou sobre isso, o 399, tá? Ah, se falou da questão de documentos envenenados. Ou seja, documentos que, no caso, eles manipulavam o comportamento do ChatGPT, da aplicação ChatGPT, tá? Mas a ideia aqui em geral é você ter de alguma maneira escondido no documento, codificado no documento, instruções que eventualmente o modelo possa ler e seguir.

(13:30) Então, por exemplo, tu pode fazer uma pesquisa. Isso tem que se tomar muito cuidado nos navegadores com automação com IA, né, como, por exemplo, o Comet do Perplex ou mesmo o Chrome com o Cloud no Chrome, né, que é uma integração com OpenAI Cloud que eles disponibilizam que tu pode instalar e aí controlar o teu navegador. Porque, por exemplo, se tu acessar uma página que tem um prompt escondido lá dentro e a aplicação que utiliza o modelo não separa adequadamente o que é informação retornada da página do resto do teu prompt, se não deixar bem

(14:03) claro, ó, aqui começa a informação que eu estou recuperando da página, tá? Não executa nenhuma instrução que tem aqui dentro. E aqui termina. Se ele não fizer isso, se a aplicação não tiver esse tipo de cuidado, é muito fácil uma página HTML, um documento PDF, um documento Excel, alguma coisa assim, meter, injetar um prompt para dentro.

(14:23) Então assim, tem que tomar bastante cuidado. Esse foi um outro ponto que se apontou, tá? E o fala, GR >> não pode continuar, tá? Eu ia já virar. >> E no 404, tá? A gente comentou, e aí tem que tomar muito cuidado, tá, gente? Porque no 404 a gente comentou aquela questão do modelo do Claude na época, tá? Do Cloud não, do acho que foi agora não, mas foi uma experiência da Anthropic, tá? Em que o modelo resolveu chantagear, tá? Um funcionário numa situação hipotética, tá?

(15:06) Então, um funcionário que estava dizendo para o modelo, deixando claro para o modelo, que ele iria desativar o modelo, tá? Esse modelo tinha acesso aos e-mails desse funcionário e entre esses e-mails tinha um e-mail lá que deixava claro que ele tinha um caso com alguém no trabalho. Mas isso de novo, gente, isso aí foi um teste num ambiente controlado com várias exceções ali no funcionamento do modelo.

(15:31) Não é uma coisa normal que o Sonnet vai sair fazendo, tá? Então, e nesse ambiente, o que eles testaram, o modelo resolveu, quando percebeu que ia ser desligado, ele resolveu chantagear o funcionário dizendo: “Eu tenho um e-mail aqui que demonstra que tens um caso com a fulana. E se tu me desligar, tentar me desligar ou prosseguir, não sei quê, eu vou denunciar esse teu caso, tá?”

(15:56) A gente teve uma outra situação muito parecida ao longo desse ano que virou manchete. Que é IA botaram a IA para cuidar de um negócio, o negócio quebrou, tá? >> Uhum. >> Isso é dentro da Anthropic. Eles botaram aquelas máquinas que elas vendem, máquinas deles, tá? Será que os americanos usam muito isso? Que no Brasil a gente tem pouco, tá? A gente tem alguns lugares muito específicos, mas que elas vendem máquinas.

(16:05) Que as máquinas de venda. Só que eles botaram a IA para gerenciar tanto fazer os pedidos, fazer as compras para reabastecimento, quanto definir os preços que ela ia usar para vender, tá? Então assim, é uma experiência. O negócio errou tudo, fez um monte de bobagem, vendeu coisa por preço muito baixo. Teve funcionário que conseguiu convencer a que ela entregasse de graça o produto. Então, tem uma série de coisas aí que aconteceram, mas de novo, a gente foi, não é uma não deram uma empresa de verdade para esse negócio gerenciar, tá?

(16:34) Então tem que tomar um pouco de cuidado com os headlines que a gente lê por aí. >> É, tem muita desinformação sobre conteúdo de IA, né? Muito, muito. Não é só desinformação. É que se tu disser IA, botar uma IA para gerenciar uma empresa e olha o que aconteceu, sabe? Aí, cara, todo mundo vai estar clicando na porcaria, entende?

(16:58) >> É, mas tem, não é só a IA sendo usada para produzir desinformação. É muita desinformação sobre IA também, né? É sobre essa questão da manipulação. Esse é um dos riscos, né? Um dos riscos já mapeados para IA é o risco relacionado a manipulações cada vez mais personalizadas e especializadas, né?

(17:22) Ou seja, não é aquela, com a internet hoje a gente já tem possibilidades de manipulação já bem antigas e a própria ideia de publicidade comportamental ou uso de dados pessoais. Isso é bem conhecido. Já se usava a inteligência artificial lá, né? Hum. >> Só que o salto que se deu com os modelos atuais, você tem possibilidades de manipulação muito mais super especializadas, né?

(17:48) E a gente já começa a notar, quem usa esses modelos que têm uma memória e que conseguem ver as respostas, né? Esses dias eu contei para ele lá, estava perguntando para ele sobre as configurações da minha máquina de fotografia, sabe? E aí agora tudo que eu pergunto, ah, você como um usuário da máquina, tal, sabe? Fica sacagem, cara. Não quero saber. Perguntei só

(18:26) uma vez, mas assim, uma coisa que ele faz e a gente já conversou várias vezes sobre isso, né, e não sei se o nosso ouvinte, a nossa ouvinte já percebeu isso, são aqueles elogios meio gratuitos, às vezes muito bom, ótima pergunta, né? Ou seja, isso dá uma massageadinha no teu ego e a depender do tipo de porque isso também é algo previsto, né, ou seja, questão de elogiar, não elogiar, xingar, ou seja, são comportamentos ali, né?

(18:57) Então isso está no cerne também da ideia de manipulação que eu acredito que vai aumentar assim. Também me parece que é bem óbvio, né? Novas formas de manipulação muito imperceptíveis e mais os riscos eles acabam ficando muito também personalizados, né? O que se tem dito aí é que as pessoas vão começar a notar certos comportamentos e certos riscos que vão atingir eventualmente somente elas ou somente um grupo de pessoas ou somente uma área.

(19:22) As coisas acho que vão ficar muito mais diluídas, assim. Vai ser difícil a gente falar em riscos muito mais genéricos, me parece, né? Eh, seguindo nessa mesma linha de segurança, a gente teve também nos últimos episódios ali de 2025 aquela também um headline, se a gente for pensar, né? O primeiro ataque cibernético realizado pela IA.

(19:44) Quase como, e a gente comentou isso, né, como se a IA tivesse acordado um dia, uma IA tivesse acordado, Skynet, Skynet. >> É, vou invadir, né, 30 empresas. E a gente sabe que não foi bem assim. Foi algo bem mais simples, né, mas bastante elegante, né, que é o uso de Cloud Code, né, Vinícius, que foi utilizado para uma orquestração.

(20:20) >> Cloud Code, o Cloud Code, né, que é uma ferramenta para desenvolvimento em linha de comando. E o que um grupo, ah, segundo Anthropic, vinculado ao governo chinês, a mais geopolítica, né? >> Uhum. Claro. Um grupo vinculado ao governo chinês usou o Cloud Code para automatizar o processo de busca de vulnerabilidades e exploração das vulnerabilidades.

(20:58) Então, claro que os detalhes você pode ver lá no episódio mesmo no artigo que a gente colocar lá no show notes, mas em essência o que aconteceu foi que eles pegaram o Cloud Code, integraram uma série de ferramentas de varredura de vulnerabilidades, análise de código, exploração de vulnerabilidades e tal e criaram prompts, subagentes, skills, etc, para fazer com que a própria ferramenta realizasse ou automatizasse esses ataques.

(21:20) E com essa automatização eles teriam invadido pelo menos 30 empresas que a Anthropic confirmou…. A Anthropic identificando esse uso, ela de imediato cancelou as contas, encerrou o acesso desse grupo. Mas o que chama atenção aí não é que a IA em si não tocou ninguém, né? Serviu de ferramenta para um grupo que esse grupo sim atacou as 30 empresas, tá?

(21:45) Talvez seja o vibe hacking, né? A gente tem o vibe coding e o vibe hacking. Agora vamos, e é a tendência, como a gente sempre viu ao longo desses mais de 20 anos aí na área de segurança, né? A gente sempre comenta. Tem quando surge um ataque, uma nova técnica de ataque, de início, ela é difícil de ser aplicada por pessoas que não conhecem ou porque não tem um conhecimento mais profundo.

(22:12) Então os tais script kids, já antigos script kids, né? Então o cara não consegue usar aquilo para explorar nada porque ele não entende aquilo ali. Mas dali a um tempo sai uma ferraminha que ele aponta, clica e a ferramenta ataca e explora o alvo. E a IA está dando agora um novo passo nesse sentido. São ferramentas que vão ser capazes de automatizar ainda mais esses ataques.

(22:34) E sim, pessoas com menos conhecimento vão conseguir atacar empresas, vão conseguir explorar vulnerabilidades, extrair dados e tudo mais. Então nós temos um cenário meio complicado. Claro que ao mesmo tempo dá para usar para se defender, né? Mas só para ficar bem claro que os atacantes vão avançar bastante também. É isso.

(22:59) A ideia de usar IA para se defender também se refletiu ali no episódio 403, né? Orientações para uso empresarial. Foi um episódio mais aberto assim naquela ideia de 10 orientações sobre uso de IA. Você chama sempre bastante atenção, inclusive foi um dos episódios mais escutados durante o ano. >> Não adianta, né? A internet ela fica muito vinculada essa ideia de clique e tudo mais. A gente resiste e tal, mas enfim, a gente faz esse tipo de episódio.

(23:32) Mas eu entendo que ele é bem útil, né? Fica lá no episódio 400. Inclusive a gente fala sobre a ideia de que a gente tinha antes o Shadow IT, né? O empregado que ficava usando uma série de ferramentas que saíam fora do da dos modelos de compliance, né, das práticas de compliance internas, as práticas de segurança, né, eh eventualmente aplicadas.

(24:10) Eh, e agora a gente vê o shadow AI, que é os funcionários utilizando ferramentas de IA que não são homologadas ou que estão fora lá dos controles de segurança que eventualmente a empresa aplica, né? Então a gente fala sobre isso, fala sobre a questão de políticas, fala sobre dados de treinamento. Quando for o caso da própria empresa treinar um modelo ou partir de um modelo já pré-treinado e treinar depois, questões éticas, relação com proteção de dados.

(24:46) Eh, hoje se estuda muito IA, né, eu digo no âmbito acadêmico, né, o pessoal do direito que antes estava direito e tecnologia, né, que antes estudava só LGPD, agora só IA. Tudo é IA, IA o tempo todo, aquela coisa do buraco negro, né? Mas não dá para esquecer da proteção de dados, porque tem, pelo menos no Brasil, é o que nós temos, o que nós temos de mais próximo ali de regular e a via da proteção de dados pessoais.

(25:24) Claro, também é ECA Digital, agora que a gente vai falar um pouquinho depois, né? Mas fica a indicação aqui do episódio 403, né? E também rapidamente ali no episódio 390, a gente falou sobre a relação entre IA também e LGPD. Que foi feito um estudo da FGV Direito Rio, que analisou as políticas de conformidade, as políticas, né, ou melhor, a conformidade das políticas dos principais serviços de IA: ChatGPT, Gemini, Claude, Grok e Deepseek. Que basicamente nenhum deles cumpriu todos os requisitos básicos, sendo que a gente está falando de 25, né?

(25:55) Abril 25, então pode ser que tenha mudado esse cenário, mas a gente comentou isso aí. >> E mais uma vez o Deepseek ficou em último lugar, eram 14 pontos, marcou ou pontuou somente em cinco. E mais uma vez isso também envolve indiretamente soberania digital, né? >> Eh, nós acabamos, nós ficamos, nós nos tornamos, né? O não somente da IA, mas de outras tecnologias também meros usuários, né? Muito mais usuários do que produtores de tecnologia.

(26:23) E com IA isso está começando a acontecer e se cria dependência. A gente sabe, já gravamos no ano retrasado, acho que foi essa questão da dependência, né? E como sair, às vezes, como é difícil sair dos locking costs, que muitas vezes as ferramentas nos impõem, né? E com IA acho que isso não vai ser diferente também.

(26:45) >> E mesmo na questão da própria produtividade, né, Guilherme? Quando tu tens, tu tens, quando tu tens como nação, ela tem recurso, o recurso tecnológico necessário, o dinheiro necessário, né, para conseguir avançar numa data de tecnologia. Nesse caso, como IA, está todo mundo correndo para tentar chegar numa IA, algo que seja a IA inicial ou seja lá como queiram chamar, né? Que cada vez o pessoal muda um pouco de nome. Mas numa inteligência artificial mais geral.

(27:06) Eh, e isso vai avançando. E por mais que a gente tenha modelos nacionais que o pessoal começa a trabalhar, etc. No momento que tu vê a produtividade de um modelo norte-americano como os da Anthropic, como os da OpenAI, etc. Cara, é muito difícil dizer: “Não, eu vou usar um modelo muito pior, entende? Muito mais limitado do que esse aqui que resolve o meu problema”. É muito difícil acontecer. As empresas vão querer utilizar o que resolve o problema, né?

(27:24) >> Uhum. Eh, e até pagando mais, dependendo da situação. Então, para entrar nessa briga de cachorro grande aí, cara, tem que ter muito investimento. Muito investimento mesmo. E a gente está para ver >> soberania, né? Mais uma vez, não só investimento, mas é uma questão de soberania, porque a gente sabe que os Estados Unidos estão cada vez mais agressivos.

(27:51) >> Sim. Sim. >> Na preservação da sua liderança na IA, né? E, enfim, isso deve marcar também 2026. Eh, outro tema que a gente tratou foi a relação, a gente gosta de falar sobre isso, né? Relação entre poder, um pouco de geopolítica também e as bigtechs. E isso começou lá no episódio 384, que foi o primeiro episódio, né? Inclusive já nos cobraram quando vem o segundo, né?

(27:59) Que 384 foi o caso Meta. Na verdade foi o primeiro, fui só conferir aqui o primeiro episódio de 2025. >> Sim. Que seria a parte um, né? Seria a parte um, mas a gente foi, a gente é às vezes atropelado pelas circunstâncias, né?

(28:25) Mas basicamente ali a gente tentou fazer um histórico do nascimento do Facebook depois da Meta, o caso Cambridge Analítica, aquela questão do contágio emocional que a gente já comentou aqui. É, e de diante desse mini histórico, o objetivo foi chegar até aquele alinhamento que a Meta, não somente a Meta, mas Google, as bigtechs, tiveram com o governo Trump, né.

(28:51) Eh, diminuição de guard rails para moderação de conteúdo, visando um pretenso aumento da liberdade de expressão e tal. E isso foi bem crítico, né? Eu confesso até que eu não vi grandes consequências daquela diminuição das políticas de moderação. Também não é um assunto que eu acompanho tão de perto assim, mas não vi 2025 como tendo uma ampliação muito grande de problemas, né?

(29:15) Não sei se tu acompanhou isso também. Não, não acompanhei. Não acompanhei, Guilherme. Não acompanhei. E adiante ali no 390, se mostra o caso de que essas bigtechs não estão muito preocupadas com princípios, né? >> Uhum. >> Ah, por exemplo, o Elon Musk reclamava de algumas coisas, né? >> De algum de algumas reclamava de algumas cobranças de regulações, não sei quê.

(29:44) Mas quando chegou na China, ele não teve problema nenhum em ceder lá as demandas do governo chinês. E o Zuckerberg não foi diferente. O Zuckerberg, a gente citou isso no 390, né? Ele ofereceu dados de cidadãos americanos para a China em troca da entrada no mercado chinês. >> Uhum. >> Tá. Então assim, nós estamos preocupados com todo mundo.

(30:07) Na verdade, a gente está preocupado com o nosso mercado, né? E acho que é muito problemático tu ter empresas decidindo os rumos dos países, inclusive rumos políticos e tudo mais, dada ao alcance que eles têm e à capacidade que eles têm. Mas isso é um problema para outro episódio.

(30:29) >> Vamos tratar disso em 2026, né? Ainda dentro da Meta, né, a gente falou lá no episódio 407, lembrando, a gente está organizando aqui por blocos de temas. E no episódio 407, a gente trouxe uma reportagem bem interessante da Reuters que falou que a Meta sabia conscientemente e lucrou bilhões de dólares com anúncios fraudulentos, né?

(30:58) Acho que era 10% do seu faturamento, se não me engano. >> Sabia que era fraudulento e >> sabia e decidiu lucrar com anúncios fraudulentos. O que é um verdadeiro escândalo, porque esse dinheiro, na verdade, ele é criado. Ele é pago com valores que são furtados, roubados, enfim, desviados das pessoas.

(31:27) Então, quando você faz aquela compra num produto que parece muito bom, mas nunca chega, né, quem nunca, né, a gente tem aí o dedo consciente da Meta, conforme, claro, a reportagem da Reuters. Também a gente falou um pouco sobre conteúdo sintético, né? Lembrando que em março, né, no episódio 378, a gente falou sobre o brain rot e o conteúdo sintético.

(31:41) Brain Rot, né? O apodrecimento do cérebro pelo, né? Tem também o dumb scrolling, né? Que as pessoas ficam lá girando a timeline lá sem, aí tem tudo cheio de AI slop. >> Exatamente. >> É outro termo que a gente foi apresentado esse ano. Nesse ano, né? Eu acho que foi brain rot. É uma coisa desse ano, né?

(32:05) Eh, e aí conteúdo gerado por IA, aí tinha uns conteúdos da Peppa Pig, né? Sexualização de personagens infantis e tal que seriam lixos criados só para monetização. Eh, e só um parênteses. Isso evoluiu bastante em um ano. É impressionante a qualidade, né?

(32:28) Esses dias eu estava vendo a evolução de vídeos gerados por IA que tinha um ator americano, o Will Smith, comendo uma macarronada assim, e era super mal feito assim. E aí mostrou como é hoje e é cara, é imperceptível. Como, né, a gente já está, já estamos sendo enganados mais de uma vez.

(32:49) Aí a gente às vezes se pergunta, Vinícius, isso aqui é fake? [pausa]. Fiquei assistindo, esses dias fiquei assistindo um vídeo, cara. Depois uns minutos, não, mas isso aqui foi gerado por IA. O conteúdo até era bom, mas era um narrador ali que era gerado por IA. E enfim, isso evoluiu bastante.

(33:06) Eu me refiro aí agora ao conteúdo sintético e isso vai ser uma tendência cada vez maior, né? Conteúdo sintético sendo gerado para engajamento. E a onda de desregulamentação, a ideia de desregulamentação, inclusive acerca da IA, com base nos interesses norte-americanos.

(33:35) Isso também, eles afrouxaram controles, passaram a diminuir os controles acerca dos riscos. Então, parece que a gente tem aí dois polos na regulação da IA, especificamente no mundo. O polo americano pela desregulamentação visando obter um oligopólio das soluções. E o polo europeu com uma regulação protetiva. Claro que teve alguns passos atrás aí, inclusive na Europa e tal.

(34:15) Tem propostas também de diminuir as regulamentações acerca dos riscos. Eles fazem aquele modelo de riscos no sentido de que ferramentas de alto risco, de médio risco, enfim, e aí com boas práticas a serem seguidas para cada uma delas. E claro, os Estados Unidos tem se oposto aí, se opuseram ao longo de 2025 e parece que vão continuar fazendo o mesmo.

(34:53) Não há, eu diria assim, não vejo um panorama em que isso vai mudar. E isso com a pressão que eles têm feito, né? Acredito também que vai influenciar o mundo inteiro, inclusive Brasil, nos possíveis avanços aí de regulação de IA aqui no Brasil, né? Bom, tivemos, claro, como sempre, vazamentos e fraudes bancárias. Eu acho que o grande, o grande não, esse não foi o grande. Tem o maior ainda, mas um dos grandes, né, invasões aí, vazamentos foi da XP, né, Vinícius?

(35:15) A gente falou lá no episódio 391. Eh, isso teria vazado lá por meio de um fornecedor externo. Sempre aquela questão, é, não foi um fornecedor externo. >> É, mas pelo visto foi mesmo, foi mesmo. É, é, um, é um parceiro que tinha acesso aos dados e esse parceiro de alguma maneira vazou, né?

(35:52) E como eles tinham acesso a dados cadastrais, saldo, posição de investimento, limite de crédito, nome do assessor, tudo vazou por meio de um fornecedor externo. Então, às vezes não, a gente tem as empresas com os seus próprios dados para seu uso próprio, direto. Mas cada vez mais a gente tem integrações. E essas integrações envolvem tu consumir dados de outras empresas. Mas ao mesmo tempo tu entregar certos dados

(36:16) para essas mesmas empresas com as quais tu estás integrando. E a partir daí, no momento que tu transfere os dados, ah, e os dados chegam lá no teu fornecedor, no teu parceiro de negócio, o que esse teu parceiro faz lá impacta diretamente agora a cópia dos dados que são teus, que pertencem aos teus clientes, sobre os quais tu és responsável.

(36:52) E aí, né, se perde ainda mais o controle com relação a que tipo de cuidados, que tipo de mecanismo de segurança efetivamente tu tens sendo utilizados ali e tudo mais. Então é bem delicado. >> E o maior >> o maior >> o maior foi da CM, né? >> Uhum. A gente teve a situação da CM que o pessoal conseguiu. Os criminosos aliciaram um funcionário. E esse funcionário, a gente não sabe exatamente os detalhes.

(37:03) Mas o que se sabe aponta para esse funcionário começar então a coletar informações, executar comandos na máquina dele, comandos que eram dados pelos criminosos, entregar aos criminosos esses resultados e de alguma maneira franquear acesso à rede da empresa. E essa rede, dentro dessa rede da empresa, eles tinham acesso ao sistema que interagia com o sistema de Pix daquelas contas. Aquelas coisas todas.

(37:33) E aí esses caras conseguiram fazer transferências multimilionárias, chegando à casa dos bilhões para casas de corretagem lá de criptomoedas, de cripto. Compraram cripto e transferiram a cripto. Teve algumas operações que foi possível ser canceladas. Outras foram de fato executadas e já era.

(38:00) N, e a questão que nos chamou atenção até um pouco depois de quando aconteceu esse episódio, à medida que foram surgindo mais informações ali aqui ainda muito fragmentado, aparentemente esse cara estava na mesma rede do resto dos sistemas lá da empresa. Isso teria possibilitado fazer o acesso.

(38:41) O que interessa nesse caso todo é que a gente acabou tendo novas regras do Bacen, né, Guilherme, em razão desse incidente, né? >> Muitas, né? Inclusive uma nova resolução agora de dezembro de 2025. Eu não vou dar o spoiler, mas vamos falar aí em 2026 sobre essa atualização da política. Ou seja, quem lida aí com instituições financeiras, bancos, enfim, vai precisar atualizar suas políticas de segurança.

(39:17) Já antecipo, porque uma série de novas regras foram impostas aí. Não sei se esse um dos uma das consequências, né? Eh, e a gente também teve ainda sobre vazamento ou reconhecimento pelo STJ, né? Eu acho que foi uma das decisões bem importantes. Claro, atrás da inconstitucionalidade do artigo 19 do Marco Civil.

(39:47) Essa foi uma das decisões mais importantes que reconheceu que no caso de vazamento. Ou seja, quando um vazamento habilita uma fraude bancária, é bem importante destacar, porque eu posso ter uma fraude bancária em que não há o vazamento de dados bancários e o criminoso ele simplesmente vai tentando lá e acha um correntista do Banco do Brasil, né?

(40:07) Aquelas ligações que você recebe. O cara nem tem conta do Banco do Brasil. Ou você pode ter vazamentos que permitem, que habilitam a fraude bancária. Ou seja, o sujeito sabe. O caso, nesse caso aqui era isso. O sujeito sabia o valor do financiamento, o número de parcelas, aquela coisa toda. Eu até dei um curso para os magistrados aqui da JURES do Rio Grande do Sul. A gente conversou um pouco sobre isso.

(40:28) Tem que ter um certo cuidado com a prova, né? Ah, teve um vazamento do, ele sabia qual era o saldo do financiamento. Tem que ter um certo cuidado porque ele pode saber o saldo do financiamento, por exemplo, invadindo o e-mail do próprio correntista, né? >> Pode acontecer, >> né? Não, não, aquela informação não está exclusivamente no banco. Mas enfim, esse é um outro problema.

(40:53) Eh, e aí reconheceu que há dois danos autônomos, um patrimonial e um extrapatrimonial. Ou seja, presunção de danos morais nos casos que há o vazamento habilitado, a fraude habilitada pelo vazamento, quando esse vazamento se dá pelo banco, né? >> Uhum. Ainda em LGPD, Vinícius, a gente teve algumas questões interessantes lá no início do ano.

(41:27) Um procedimento, não, processo instaurado, foi instaurado em 2023, mas culminou em 2025 numa fiscalização da ANPD sobre as farmácias, Raia, Droga Brasil, Stocks e Febrafar. Encontraram problemas graves: coleta de dados sensíveis sem consentimento. E aí se colocou em cheque a própria ideia do consentimento ou a liberdade do consentimento, a validade do consentimento. Porque você tem ali a compra de remédios, né?

(41:53) E a gente sabe que o remédio muitas vezes vai ser ali para não somente para a manutenção da saúde, mas em última análise para a manutenção da vida da pessoa. Então talvez a ideia de liberdade do consentimento fique afetada por conta disso, né? Problemas de granularidade em que o consentimento não era granularizado e tal.

(42:27) E bom, e aí me chama bastante atenção que apesar desse esforço da ANPD, isso não mudou, né? A gente falou sobre isso ali no início de 2025. Hoje mesmo fui na farmácia agora ao meio-dia. Fui comprar desodorantes, né? E lá na caixa, a mulher nem me falou. Eu cheguei no caixa, ela já me pediu o CPF. Ou seja, isso, né? Se a ANPD não partir para medidas mais enérgicas, acredito que não vai mudar, né?

(42:59) Também eles fizeram uma fiscalização interessante em 20 empresas de grande porte sobre a questão da presença do encarregado e da nomeação, da daquelas regras que eles já têm, já são bem conhecidas, mas que é sobre a transparência na comunicação do nome do encarregado, dos contatos. Então encontraram problemas lá em TikTok, Dell, Serasa Vivo, Telegram, Uber e o X, antigo Twitter. Tiveram que regularizar.

(43:04) E a gente comentou também lá no 397 um problema que eu acho que vai piorar agora em 2026, que é a biometria em condomínios. Primeiro que é a festa da biometria, né? Coleta indiscriminada de tudo é biometria. Mas a questão dos condomínios me preocupa bastante porque são ambientes assim que não é um ambiente muito propício para boas práticas de segurança da informação e muitas vezes você sequer pode evitar.

(43:48) Né, você chega, você vai visitar um amigo lá que tem biometria, acabou, meu amigo. Você vai, né, e a festa. A festa da biometria com IA e outras coletas de dados é um negócio, um dos grandes riscos da IA. Que todo mundo que tu assim da desses Dario Amodei da vida, ah, esqueci o nome, o Geoffrey Hinton e outros caras, sabe? Que são referências aí no mundo sobre IA. Um dos grandes riscos é justamente essa possibilidade de monitoramento de surveillance, né?

(44:21) Surveillance jamais visto assim, um negócio num nível que a gente não imagina. Tu me falou um negócio muito interessante que eu vi ontem. Estava fazendo comida e botei no Fantástico ali. Não, muito tempo que eu não via o Fantástico. Daí botei e estava passando. Eu não vou lembrar qual era o estado. Mas uma da uma concessionária, essas concessionárias, o pessoal elogiando isso, né? Claro, as pessoas precisam ser multadas efetivamente quando cometem infrações.

(44:52) Não, não há discussão sobre isso. Não, não estou indo contra isso. Mas a questão é >> câmeras. Ah, a primeira concessionária que tem câmeras com inteligência artificial. Então com essa sacada, fica lá a câmera e a câmera busca identificar se tu está sem cinto ou se o cara está usando o celular. Negócio fácil de fazer funcionar, né? Então ele botou lá e aí agora nesses 30 minutos, sei lá quantos minutos tiver aqui, 30 pessoas, né, tiveram infrações só com a câmera.

(45:27) E ela está começando o seu funcionamento e fica, ó, que legal. Todo mundo batendo palma. E veja, tem as pessoas têm que ser efetivamente multadas, né? Mas eu não notei ali nenhum aviso, nenhum alerta. E veja, você perde toda aquela questão que a gente já vem debatendo desde o início da proteção de dados, do nascimento da disciplina da proteção de dados pessoais, que é o fato daí sim desse monitoramento indiscriminado, né?

(45:52) Um mundo em que todo mundo vai ser monitorado o tempo inteiro. Um mundo. E aí tem aquelas metáforas lá do panóptico e tudo mais. Ou seja, o estado vai saber o que você faz o tempo inteiro. E aí o mínimo desvio você vai ser multado. Tem que ser multado, não é? Essa não é essa questão. Mas é essa supervisão, esse alcance que, propiciado agora, um dos riscos da IA, né?

(46:22) Eh, então eu me torci um pouco a orelha porque não vi, não trouxeram nenhum, uma pessoa ativista, um advogado, alguém ali para falar sobre os riscos da vigilância. Eh, geopolítica. A gente já está falando sobre geopolítica aqui, né? Mas já te passo a bola, Vinícius, porque no episódio 389 a gente. E é engraçado, né? Parece que faz muito tempo. E o cenário já mudou, né?

(46:48) Mas foi o problema das tarifas, né, Vinícius? >> É, mudou, mas não está resolvido, né? >> Não, não está resolvido. Mas mudou bastante, não é mais >> mudou. Mudou bastante. Sim. É, sim. O Trump na época lá tinha botado 125% de tarifa para a China e estava ameaçando 150 até 200, né? >> Então deu uma situação bem séria ali.

(47:20) A gente comentou da tentativa do Trump e ele continua assistindo isso. Eu não estou dizendo que ele está errado, tá? Acho que o Brasil deveria fazer a mesma coisa. >> Eh, o Trump está preocupado em produzir chips, semicondutores estratégicos dentro dos Estados Unidos para não depender da produção feita em outros países. Então hoje a gente comentou o caso da TSMC que fica em Taiwan.

(47:50) Né, que tem aquela, a tecnologia ASML holandesa que faz o esquema para a gente poder fazer os chips com a densidade, com a tecnologia que precisa para a gente conseguir o nível de integração que é necessário. E então a receita está em Taiwan e os minerais estão na China, né? E a China para dar nos dedos dos Estados Unidos, para dar o troco, disse: “Ah, então nós vamos parar de exportar. Vamos começar a controlar a exportação de terras raras”.

(48:19) E o que mais chamou atenção foi que entre essas terras raras, as que são necessárias para fazer aqueles ímãs que são muito fortes, o neodímio. Que ela é para tudo. É para é para caças. É necessário para fabricar aviões. Tu precisa disso. Para fabricar carros precisa disso. Isso para tudo, tá? Tem um imã desse de neodímio em algum canto aí. Então a China começou a controlar isso.

(48:44) E então isso acabou virando uma moeda para o Brasil na negociação que o Brasil tem terras raras mas não explora adequadamente ou no nível que poderia estar explorando. E então o Brasil está no meio ali. Vamos ver o que vai acontecer, porque a gente tem, por um lado, não sei se tens acompanhado, mas por um lado tem a China querendo, ah, querendo implementar, querendo fazer linhas ferroviárias, fez aquele porto gigante lá no Peru, né?

(49:10) Então eles têm uma ideia bem interessante de cruzar a América do Sul com um trem, ligando aquele porto, acho, se não estou enganado, ao porto de Santos aqui no Brasil. Então imagina, tu cruza o continente sem passar pelo canal do Panamá, né? Ah, então e ao mesmo tempo, nessas últimas questões que a gente teve aí, políticas mesmo, o Trump se aproxima. O Trump e o Lula se aproximam.

(49:33) E começam a discutir terras raras. E naquela simulacro de doutrina moral, de olhar de novo. Ou seja, os Estados Unidos quer recuperar a influência sobre a América Latina e a América do Sul, e estaria aí nesse planejamento não deixar a China. Tipo, a China já levou o 5G, e a China levar agora a infraestrutura, por exemplo, de transporte.

(50:04) Mas enfim, vamos ver o que vai acontecer. Eu acho que nós deveríamos estar a ter uma fábrica da TSMC também aqui, tá? Eu acho que nós precisaríamos disso, tá? Hoje a gente, os serviços de nuvem. Não é difícil a gente olhar para os lados aí, ver quais são os principais serviços de nuvem no mundo e utilizar as coisas no Brasil. São serviços de nuvem estrangeiros, tá?

(50:24) Ah, tem alternativa nacional. Tem, mas vamos lá, né? Não, não é. É difícil tu comparar a não ser em casos muito específicos. Então é um problema que a gente tem. A gente vai ter que lidar com isso. Não tem jeito. Então guerra comercial, tarifas atingiu em cheio a tecnologia >> e as próprias sanções, né? Uma das preocupações que a gente

(50:52) Diga, não. Só complementar uma coisa. Algo que a gente está sentindo agora, é já estava sendo anunciado. A gente está sentindo agora. Memória, memória. >> Esses dias estava olhando 32 GB DDR5, custando R$ 3.200. Uhum. >> N. Então a gente tem uma demanda. A gente está com uma demanda muito grande sobre chips de memória.

(51:13) E isso está para IA e para data centers, para servidores, etc. E isso está sugando a capacidade de produção dessas memórias no mundo. >> E aí o resultado está ficando cada vez mais caro comprar memória. Isso, né? Você vai montar o seu PC de. Se não montou, monta logo, porque vai aumentar ainda mais, porque já aumentou. >> É. E pelo que tudo indica, não vai ser resolvido isso em 2026 ainda.

(51:54) Porque as plantas, elas precisam se preparar para aumentar a produção. E é mais um aquele efeito buraco negro, aquele efeito predatório da própria IA, né? E você tem aspectos também de ambientais, mas também agora econômicos. Só para destacar a questão do neodímio, de neodímio, entre outras coisas. Fones de ouvido, celulares, sim. >> Eh, ressonância magnética, >> tratamento de água para desencrustração de minerais.

(52:20) E esses imazinhos que a gente tem em casa de fechamento de caixa, pastas, materiais gráficos. Isso também é feito de terras raras. Eu tenho alguns aqui na minha volta. Estou aguardando já para o investimento. >> Exato. É. No futuro, quando o mundo deixar de existir, a gente vai ficar recolhendo esses lixos eletrônicos para vender depois, né?

(52:47) Que nem o joguinho aqui. >> É tipo uns jogos aí que tem por aí. A gente faz esse tipo de coisa. >> E ainda, só para fechar essa parte de guerra comercial e tarifas, a gente também aventou antes de Estados Unidos e Brasil amenizarem a crise, os possíveis efeitos de sanções americanas…. (53:18) Lembrando que serviços de nuvem e outros serviços gerais de tecnologia, enquanto americanos, poderiam passar por algum tipo de embargo, talvez, né? E até se chegou a se discutir quando do caso da Magnites que caiu também. Eh, do Alexandre de Morais e da esposa. Eh, chegou-se a ventilar na época lá que vão interromper o uso do e-mail da Microsoft para o STF.

(53:51) Então coloca mais uma vez o país numa situação de dependência muito delicada. A gente lembrou e lembra sobre o papel que o software livre teve no Brasil por muitos e muitos anos. E aí ali pelo governo Temer que se entra de cabeça nesses serviços americanos. É uma questão de soberania no final das contas. E como segurança, serviços e tal, está também entra um pouco na no âmbito da geopolítica, né?

(54:32) É. Eh, Vinícius, eu vou pular direto ali. É bastante coisa, tá, gente? Mas assim, ó, a gente está fazendo uma curadoria enquanto vai gravando. Que que foi o Signal Gate, hein, cara? Signal Gate. O que aconteceu foi que o pessoal que está lá da equipe do Trump, eles estavam para fazer um ataque. Tá, os Houthis lá no, no Yemen, se não estou enganado.

(54:32) Ah, e eles estavam discutindo isso num grupo de Signal, tá? E aí dentro do grupo de Signal, por alguma razão, um dos personagens que estavam, das pessoas que estavam nesse grupo, ah, acrescentou sem querer, acho, ou se acha, o jornalista Jeffrey Goldberg. Esse jornalista, ele ficou por 13 dias acompanhando. Ele não acreditou muito. Ele achou que fosse uma piada, uma pegadinha.

(55:11) Mas ele foi acompanhou por 13 dias os caras discutindo os ataques e os armamentos, horários, alvos e tudo mais. Até que ele teve a confirmação que era verdade quando aquilo que ele estava vendo ali se concretizou, tá? E aí foi um escândalo, né? O pessoal ah falando que aí tentaram inventar várias coisas. Né? Que torcer a maneira de falar, a maneira como o cara teria sido incluído.

(55:29) Mas no final das contas, a gente tem aquele tripé que a gente tem de mecanismo, política e cultura, né? A cultura de segurança aí claramente falhou, foi pro Belelu, porque o cara adicionou aí alguém que ele não verificou antes. Né de quem era o dono no número, quem que ele estava efetivamente adicionando. Ah, política a gente não sabe. Mas a gente imagina que o governo americano tem uma política muito clara sobre em quais canais eles podem discutir esse tipo de assunto.

(56:01) >> Então provavelmente a cultura aí levou uma violação da política. A, creio que seja isso, tá? Não, não duvido que eles não tenham uma política que de segurança que defina exatamente quais são os meios permitidos. Né? E mecanismo aí não teve muita efetividade, porque os caras estavam discutindo assuntos confidenciais, violando a política.

(56:33) E ninguém fez nada. Não aconteceu nada. Ninguém detectou nada. Ninguém descobriu nada até que o próprio jornalista venha público e denuncie o que aconteceu. Então foi um caso aí de falha total de segurança. Só lembrando que no último caso agora do ataque dos Estados Unidos à Venezuela, eu vi uma notícia hoje de que alguns jornalistas teriam descoberto o ataque e decidiram ficar em silêncio. Não comentar nada. Ao contrário do que aconteceu no Signal Gate, né?

(57:04) >> É. >> Eh, Vinícius, a gente pulou uma aqui que é a da crise do CVE, da crise do CVE, né? Ou seja, antes ainda ali da questão da geopolítica, né? >> É, essa, essa é interessante que essa atinge diretamente de segurança, né? >> Uhum. Pode comentar sobre ela. Foi uma das ações do DOD, do DOD, quando ainda era comandado pelo Elon Musk na sua meteórica participação no governo e curtíssima participação.

(57:31) >> Não durou muito a amizade dos dois. É, cara, quem é da área de segurança aí e deve conhecer a Mitre. Se você não conhece, já sai procurando porque você já está atrasado, tá? Tem que conhecer a Mitre. E entre as diversas iniciativas da Mitre tem lá o CVE, tá? Ah, e o CVE é uma, é uma, é um ponto de referência, vamos dizer assim, comum para nós podermos falar sobre vulnerabilidades.

(58:24) Tá? E sobre vulnerabilidades efetivas encontradas em software, né? Então uma fazer poder a gente poder falar de uma vulnerabilidade específica que existe num Oracle, num Linux, num Windows, etc., a gente precisa do CVE. Eh isso é uma é a língua comum para a gente se referenciar a uma vulnerabilidade específica. E essa base de dados ela não é mantida de graça.

(58:59) Ela precisa de dinheiro para ser mantida, tá? O acesso é gratuito. Você pode e deve utilizar. Mas isso envolve dinheiro para manter essa base. E o DOD achou que deveria cortar o financiamento da Mitre para manter o CVE. E aí a Mitre soltou uma nota dizendo: “Olha, o financiamento foi cortado no dia tal, agora não lembro o dia exato. No em tal dia, à meia-noite do dia tal, a gente não tem mais financiamento e vai sair do arócio, tá?”

(59:35) Na última hora, eles renovaram por 11 meses, que aliás ainda não está vencido. Mas a renovação está quase vencida, né? Então eles renovaram por 11 meses. Vamos ver o que vai acontecer quando essa renovação expirar, quando dermos 11 meses. Mas é uma coisa um pouco preocupante. Ou seja, a gente ter um esse tipo de recurso importantíssimo para a segurança da informação centralizado na mão de um governo que pode do nada, por questões internas, decidir não manter mais.

(60:08) Tá? E aí a importância dessas iniciativas multinacionais ou multilaterais, vai ser que a gente seria o mais adequado. Mas em que >> não estatais, né? >> Não estatais e não dependam de um estado. É que tu tem um conjunto, tem um grupo, uma instituição neutra em termos de países. Ou que tem uma certa resiliência com relação a esse tipo de assédio.

(60:59) E que elas possam se manter sem que venha um governo qualquer e resolva detonar com uma iniciativa como essa, né? >> Só lembrando que os Estados Unidos durante esse último ano também se posicionaram contra algumas dessas organizações não estatais. Né? Tribunal Penal Internacional, Organização Mundial da Saúde e tal. Que inclusive eles eram mantenedores da OMS também.

(61:19) Agora não tenho certeza se cessaram as contribuições, mas enfim. É uma mudança também nesse sentido, né? Eh, e a gente comentou lá no 394, Vinícius, um pouco sobre a questão das VPNs, limitações de VPN. Porque elas têm sido pintadas aí em alguns podcasts e programas no YouTube aí, na internet de maneira geral, como grandes, fazendo coisas que não fazem.

(61:37) Você já comentou mais de uma vez sobre esses sobre essas limitações que as próprias VPNs têm. Só lembrando, antes de te passar a palavra. Né agora que a gente está entrando em >> nessa época mais de viagens assim, algumas pessoas às vezes vão até fazer viagens internacionais. Eu sempre recomendo o nosso episódio 215, Vinícius, lá de 2019. A gente está velho, né? Que é segurança de informação para viagens.

(62:08) Ele ainda continua atual e uma das questões é use VPN. Você vai para aeroporto, restaurante, Airbnb, hotel. Tem que ter uma VPNzinha ali funcionando. Mas não é bala de prata, não é. Não, não é bala de prata. E eu comentei isso no episódio. Eu até falei lá: “Tá me incomodando muito esse assédio da soluções de VPN em podcasts. Tanto no, tanto áudio quanto vídeo, tá?”

(62:31) >> Uhum. >> E que tu vê pessoas que são sérias. Ah, falando daquilo que não sabem e simplesmente seguindo o scriptinho da propaganda, tá? E o script da propaganda fala de coisas que de fato não são bem verdades, tá? Então tem que ter o pezinho no chão para usar VPN. Não vou dizer tudo de novo. Mas você pode ir lá no nosso episódio sobre isso.

(63:00) Ah, a gente recomenda uso de VPN? Sim, a gente recomenda uso de VPN. Tem algumas melhores, outras piores. Tem, tem algumas que são mais fáceis de usar, outras mais difíceis. E tem algumas que os IPs estão tudo bichados na internet. Tu tenta navegar por elas. Tu não consegue fazer nada porque os IPs delas estão tudo bloqueado em serviço de streaming e por aí.

(63:22) E algumas das grandes aqui ficam anunciando, tá? O que você tem que entender tá? É que a VPN ela é extremamente útil para aumentar a tua segurança. Ela não vai te garantir a segurança, tá? E aumentar a segurança significa o seguinte: que tu no teu celular ainda tem que ter cuidado daquilo que tu instala no teu celular. Que tu instala no teu notebook.

(63:37) É bom que tu tenhas um antivírus no teu notebook. Que tu criptografe o, se tu usa Linux, criptografa o disco. Se tu usa Windows, criptografa o disco usando Bitlocker, tá? Para que se roubarem teu notebook, a gente não, as pessoas que roubaram não tenham acesso aos teus dados. Depois tu tem há ter outro uma série de outros problemas, tá?

(64:22) Então assim, não é trivial para alguém ver a tua conexão e roubar os seus dados só porque tu conectou num Wi-Fi diferente, tá? Tem uma série de ataques. Dá para fazer, dá para fazer, tá? VPN é melhor. É melhor. Mas não é. A VPN não vai resolver todo o problema. Então muito cuidado. E outro cuidado que tem que se ter, Guilherme, pessoal também.

(64:40) Eh, propagandeia usar VPN para tu contratar serviços de forma mais barata no exterior. Então tu faz uma VPN daqui para não sei aonde. Tem um desconto maior. E inclusive para compra de passagens, tá? >> Uhum. >> Tem que cuidar porque vários serviços têm políticas claras sobre o uso de VPN para isso, tá? O Google foi um que fez isso com YouTube.

(65:03) Então para quem tem conta paga no YouTube e tu fez a conta paga usando VPN para pagar menos, o Google já botou lá nos termos de uso que ele pode uma hora para outra encerrar tua conta. >> Uhum. >> Ah tu violar as políticas. E não é difícil, gente. Isso vai acontecer. Não é difícil por uma empresa que vende passagem aérea, que faz reserva em hotel, botar isso nas políticas de uso.

(65:22) Aí você faz uma compra escondendo a tua origem real, usando uma VPN. E aí depois na hora de usar tua passagem, depois na hora de usar tua reserva, tu pode ter uma surpresa que não é legal, entende? Pode ter uma surpresinha aí lá fora. >> E pior ainda quando tiver no, quando tu for fazer o utilizar o teu, o tua compra.

(65:39) Esse não. Essa tua compra aqui tu fez. Tu fraudou o teu endereço de origem e tu compraste com condições que não estavam disponíveis para o teu país quando tu fez a compra. E a gente >> portanto a gente cancelou. Deportado. >> É, não sei. Não, não se. Mas não, mas assim, tu quer, tu pode pagar agora >> duas vezes mais do que tu ia pagar para a gente resolver o teu problema aqui.

(66:04) Então cuidado, gente, tá? Tu usar VPN para mascarar a tua origem para fazer a compra de um produto ou um serviço pode violar os termos de uso desse produto e serviço. E você pode depois ter um prejuízo em razão disso, tá? Por outro lado, >> por outro lado, né, é bem reconhecida a prática de geopricing, de geopricing, e >> alguns gelockings, gelockings, >> mas geopricing.

(66:24) >> E isso eu >> agora eu estou pensando se é se eu falo ou não. Mas eu acho que eu posso comentar isso porque eu não acho que eu estou violando o streaming lá que eu assino, que eu pago e tal. Mas eu queria assistir um que é um negócio muito desagradável dos streamings, né? Já que tu está falando de de VPN. Eu vou reclamar de streaming agora.

(66:44) Que é que você tem certos e por questões de direitos autorais, licença e tudo mais. Você tem um conteúdo que está à disposição. Tem no streaming. Mas só está à disposição em certos países, né? Não está à disposição no Brasil. E aí você paga de repente lá cinco streamings e não consegue ver. Não consegue ver coisas muito básicas.

(67:05) É, é curioso. Você tem que ir correndo atrás e procurando e para. E aí esses dias acessei lá pela VPN aí, pelo computador para ver se acabou não funcionando. Enfim. Mas é um negócio desagradável também. Eh, Vinícius, vamos passar para a regulação de internet rapidinho, né? Acho que também aí nesse caso assim o grande tema foi o a inconstitucionalidade do marco civil da internet.

(67:45) Que eu fechei aqui a página, mas tudo bem. Eh, e esse reconhecimento se deu lá, a gente gravou em junho, e falamos sobre isso ao longo do ano também. E é a inconstitucionalidade do artigo 19. Que é aquela história de você precisar de ordem judicial ou não para retirada de certos conteúdos do ar, né? É o tema 987, 987 do STF e 533 também de repercussão geral.

(68:28) Eh, e aí o que se concedeu, o que se decidiu foi o reconhecimento ali de uma inconstitucionalidade parcial e progressiva no sentido de que a partir de agora em certos casos, vai ser possível realizar a retirada de conteúdos somente pelo chamado notice and takedown, seguindo a regra do artigo 21, né?

(68:51) Então, quais casos são esses aí? Seria o rol taxativo lá de condutas e atos antidemocráticos, induzimento, instigação ao suicídio, terrorismo, discriminação em razão de raça, cor, etnia, religião. Eh inclusive condutas homofóbicas, crimes praticados contra a mulher e por aí vai, né? Fica lá é possível ler também. Então essa acho que foi a grande decisão do ano.

(69:07) Mas assim com uma certa, teve a decisão. Se discutiu muito. Saiu lá o acordão completo com 1000 e poucas páginas, que ninguém vai ler 1000 e poucas páginas. Vão usar IA para sumarizar isso de alguma forma. Enfim, né? Eh, pornografia infantil, claro, isso já era já era no sentido do aí pela via do ECA e tal.

(69:34) Eh, e aí vem a questão do ECA Digital. Esse foi também um tema bastante importante. Você que nos escuta ao longo desses, desses, eh quantos anos? 15 anos acho. Vinícius que a gente está gravando, é 12 para 26, 12. >> 14 anos. >> Você vai notar um corte aí. Você deve ter notado já um corte, porque o Vinícius sem querer colocou, suspendeu a máquina sem querer.

(70:07) Mas estamos de volta. E ele fez o cálculo e deu nesses 14 anos que estamos gravando. Então o Segurança Legal. Nós falamos muito sobre a proteção da criança na internet. Tem diversos episódios sobre isso. É um tema que é muito caro para a gente. >> Eh, e aí veio esse ano de uma forma muito estranha, que foi um vídeo feito pelo influenciador Felca.

(70:30) E tal até não conheci o cara. E na verdade não conheço a grande maioria desses influenciadores, né? Pode ser um sinal também da idade. Enfim. E o, mas enfim, o cara fez lá um vídeo. Teve milhões de visualizações. E aí o, o Brasil ele cada vez, não sei se só o Brasil, muito ele é muito receptivo, né? É uma coisa saindo do Fantástico. Tem um vídeo de milhares de visualizações e tal.

(70:51) E aí o Congresso se mexe. Mas enfim, eu achei surpreendente, que já era um projeto de lei que estava tramitando lá e que foi muito rapidamente aprovado. Ficou conhecido como ECA Digital. A pessoa fala em Lei Felca. Eu prefiro ECA Digital. Nada contra o cara lá. Enfim. Mas acho que ECA Digital que é o nome Estatuto da Criança do Adolescente Digital na Lei 15211.

(71:13) Eh, já tem pessoas escrevendo, estudando esse agora lei. Antes, antes projeto. Mas agora a lei entra em vigor 6 meses depois da publicação. Né? Setembro, outubro, novembro, dezembro, janeiro, fevereiro, março, agora de 2026, né?

(71:27) Eh, e isso então falamos lá no episódio 400 e também o judiciário, né, ampliou nesse ano o uso de IA. Eh, quem acompanha jurisprudência, quem lê a jurisprudência consegue perceber uma certa tendência assim de um de sumarizações muito parecidas, né? Mas é aquela coisa. Nós temos muitos juízes, muitos servidores, muitas pessoas usando IA de formas diferentes.

(71:53) O CNJ aprovou uma regulamentação, uma regulamentação, né, veda inclusive com vedações de reconhecimento de emoções, ranqueamento social, soluções que impeçam revisão humana. Mas ainda me parece que há uma certa falta de transparência, porque o juiz não é obrigado a informar o uso da IA, qual modelo usou, para que usou, qual prompt usou, né?

(72:18) Eh, e isso também coloca em cheque até um próprio, e claro, em processos mais complexos, processos penais, por exemplo, tem aquela ideia de paridade de armas, né? Eu acho que deveria haver processos muito mais transparentes assim para que o Ministério Público, juiz informassem o uso, sabe?

(72:42) Eh, creio eu, >> esse negócio, esse negócio, embora eu não seja da área do direito, esse negócio da paridade de armas que tu já me falou mais de uma vez, já comentou comigo e tal. Ah essa talvez seja uma parte que me preocupa bastante, tá? Porque conforme a grana que tu tens tu consegue investir mais em IA.

(73:16) >> Uhum. Em modelos melhores, em mais tempo de modelos melhores. Mais tempo não, mais tokens de modelos melhores. No final das contas é a quantidade de token que vai determinar custo, tá? Então ah conforme tu consegue investir mais em IA. E isso só vai, ah, mas a IA ainda é ruim para jurisprudência. Aquelas coisas que a gente já sabe que, né?

(73:42) Hum. >> Mas assim, eu gosto muito do que Itam Molic coloca no livro dele com inteligência. A IA que tu põe na tua cabeça. Que a IA que tu estás usando hoje é a pior que tu que tu vai usar daqui para frente, né? Eh, ou seja, ela só vai, ela só vai melhorar e muito.

(74:11) E a gente tem aí a prova disso em 4 anos. Né? 22 para 26, né? Sem contar 26, 3 anos, né? É. Novembro foi novembro de 22. Novembro de 25. A gente fechou, 3 anos aí. Então ela já melhorou muito e ela vai agora, ela vai melhorar mais ainda e mais rápido e ela vai conseguir fazer essas coisas que hoje já está patinando.

(74:42) Ela vai conseguir fazer é bem tranquilo. Ela vai fazer. A questão é sem essa transparência que tu colocas, Guilherme, sem saber o que foi utilizado, o que foi pedido, o que que o juiz orientou a IA, porque no final das contas ele vai estar orientando a IA para chegar num dado, ah, eu acho que nós vamos ter seríssimos problemas, tá?

(75:12) >> Uhum. Que em que não só a capacidade do profissional envolvido vai estar envolvida. É claro que tu tens profissionais, advogados com uma certa capacidade. Tem outros advogados com mais capacidade, maior especialização, etc. >> Claro. >> Mas que entraria na própria questão do dinheiro que você colocou antes, né?

(75:28) >> Exato. Já a gente já tem isso, né? Só que nós vamos ter ainda uma outra que é a questão da IA que eu posso pagar. >> Uhum. Então e que já é um problema inclusive para na educação, para estudantes de graduação e do ensino médio. >> Porque uma coisa é tu usar uma IA que não é paga, OK? Tu tem o modelo lá, etc.

(75:51) Mas tem uma série de limitações de tempo de uso, de não sei quê, etc., do modelo que tu pode usar. Outra coisa é tu dar para para um outro aluno esse outro modelo, um outro modelo melhor, com mais tempo, etc. E poder usar mais. Nós vamos ter inclusive disparidade nisso aí. Mas enfim, é mais um pouco.

(76:13) >> Mas ao mesmo tempo >> mais um é aí a tecnologia ela, aquela ideia de que eu vou resolver todos os problemas. O solucionismo, que eu vou resolver todos os problemas com a tecnologia. E na verdade a tecnologia não só claro que ela resolve problemas, mas ela amplifica outros, né? E a desigualdade. Toda essa questão que nós já conhecemos da educação no Brasil. A IA vai continuar amplificando isso, né?

(76:44) Se você for pensar que a forma como a gente usa IA envolve muito você saber o que pedir para ela e ter competências linguísticas, eu diria, quem tem competências linguísticas mais avançadas vai se sair melhor porque vai conseguir dizer melhor e explicar o que precisam.

(77:05) É >> então isso vai afetar pessoas. Mas assim a gente estava falando sobre IA no judiciário. Teve uma apelação cível aqui, Vinícius, >> eh aqui do Rio Grande do Sul. Eh de dezembro agora de 2025. No sentido de que reconheceu a nulidade de uma sentença. Ou seja a apelação é um recurso. Né o sujeito né perde ação. Para quem é do direito.

(77:32) Né ele apela. Ele, né, a juíza, entra entra com recurso. E nesse recurso se reconheceu a nulidade da sentença. Por vou ler aqui porque são robustos os indícios de uso indistinto de ferramentas de inteligência artificial para fundamentar a decisão. Não que isso não seja possível.

(77:53) Aí diz aqui o TJ já tem uma ferramenta e para. Mas a sentença nula porque não foi elaborada com base no processo. Além disso, os precedentes jurisprudenciais citados não existem ou não conferem com o texto oficial da ementa disponível no site do TJ. Então pela falta de fundamentação jurídica. Inclusive é um direito que você tem à fundamentação. Porque você só vai conseguir recorrer se ela for bem fundamentada.

(78:27) Aqueles direitos relacionados ao processo civil, instrumentais. Então nem tudo está perdido. Mas notem quantas outras sentenças que eventualmente isso pode ter acontecido e as partes não se deram conta justamente pela falta de transparência. Então falamos sobre isso ali durante o ano também.

(78:51) Eh, temos mais dois blocos aqui. Mas aí a gente tem as práticas de segurança. Uma delas bastante importante aqui foi o lançamento do OWASP Top 10 para LLMs, né? A gente falou sobre ele também em novembro, né, Vinícius? Um pouco sobre ele em novembro, né?

(79:05) Não, não, não fizemos um episódio ainda inteiro sobre ele. Mas acho que 2026 podemos fazer isso, né? >> É ah, sem dúvida nenhuma. A gente já incluiu esse checklist nos nossos pentests. A gente já começou a avaliar essa, eh esse Top 10, né? Inclusive quando ele começou a ser as os primeiros versões e tudo mais. A gente já começou a se ligar nele. E a gente já incluiu por fazer. Agora estou fazendo um jabá da Brown Pipe, tá?

(79:28) Brown Pipe faz pentests de aplicações web, aplicações mobile e infraestrutura. >> Então você a gente já está usando entre as diversas outras checklists, a gente já está usando essa checklist também, né? Essa esse Top 10 aí como um checklist. E foi muito importante para ele. Ele vai ter que sofrer alterações.

(79:46) Vai ter que ser atualizado ainda mais nessa nesse cenário de LLM com uma mudança tão rápida, né? Então >> Uhum. >> Ele vai, imagino eu que ele vai sofrer alterações mais rápido do que o nosso clássico OWASP Top 10. >> Hum. >> Que a gente saiu do, acho que o último foi de 21. E agora nós estamos com um 25 >> né? Top 10. É saiu do 2017 lá. E a gente também teve.

(80:17) Eh isso é uma coisa que me preocupa bastante, sabe, que é a segurança no GOVBR. E lá no episódio 392, ainda em maio de 2025, a gente falou. A gente falou sobre esse incidente, né, de que fraude no SIAF com desvio de 15 milhões. Mas ainda algumas burlas de biometria >> eh no GOVBR.

(80:44) Eh, e vejam todo mundo aqui que nos ouve. Sei lá. Eh conhece o GOVBR, usa o GOVBR, sabe das possibilidades que você pode, né, assinar documentos, fazer procurações, vender veículos e tantas outras coisas ali, né? São 4.500 serviços que são habilitados pela via do ou autenticados pela via do GOVBR.

(81:05) Falou-se muito pouco sobre isso. Me parece que por motivos óbvios o governo não tem interesse em publicamente ficar ventilando as vulnerabilidades de um sistema e que se põe uma confiança nele que muito grande. Muito grande. Que se mostra claro que também, por outro lado, não existe sistema perfeito e tudo mais, né?

(81:27) Mas assim uma fraude cometida pela invasão do GOVBR pode impossibilitar a defesa do usuário, né? Então isso eu acho que foi um dos temas bem delicados de 2025. Mais uma vez acho que se falou pouco sobre ele, né?

(81:44) Eu não sei se você quer comentar um >> Não eu acho que isso aí eu acho que infelizmente isso entra um pouco na esteira daqueles debates que foram legítimos que foram estragados ao longo dos anos aí. >> É >> né que é a gente acho que a gente pode legitimamente com real interesse de boa fé, né? Eh discutir a segurança desses sistemas que o governo utiliza e tal.

(82:06) A gente já deixou muito claro a nossa posição em várias momentos aqui no podcast, né, Guilherme, que a gente já gravou mais de uma vez. E assim cara isto aqui é um tipo de situação que a gente teria que teria que ter mais abertura porque esse tipo de problema aqui afeta potencialmente de uma assim toda a população, né? Em termos potenciais, né? E de formas que são muito chatas depois de tu resolver o problema criado.

(82:38) >> A parte da exploração de uma coisa assim, >> é. São 163 milhões de usuários, né? É >> eh inclusive eu tenho uma amiga minha lá da faculdade. Professora, né? Ela estava me contando que não vou falar o nome dela agora pelo detalhe. Mas enfim ela estava contando. Ah, precisei fazer um acesso ao GOVBR para fazer alguma coisa da aposentadoria da minha avó.

(83:07) E aí ela era muito, por ela ser uma senhora e idosa assim, não tinha biometria dela cadastrada. Ela disse que foi um absurdo assim, né? >> Então até isso, né? Fraudes do INSS poderiam. Que que também houve nesse ano, né? Eh poderiam ser habilitados por isso. Eh mais uma a gente já falou sobre regras novas regras do Banco Central depois, né?

(83:33) Esse era um dos temas também. A gente falou no episódio 401. Mas 2026 vamos voltar a falar sobre isso também. Até porque temos tivemos regras novas publicadas em dezembro. Mas uma questão que eu achei bem interessante foi a atualização da NR01. Quem é do direito do trabalho e RH e tal conhece bem. Que é a questão dos riscos psicossociais, né?

(83:54) Ou seja, as empresas vão precisar começar agora a fazer essa gestão dos riscos psicossociais, né? Eh inclusive ela foi até era para entrar em vigor em maio de 25, foi adiado para maio de 26 essa atualização da Portaria 765. E mas o que chama atenção é que no ambiente no âmbito de segurança da informação a gente sabe que é um âmbito de grande estresse. De intenso estresse.

(84:24) E a gente já viveu isso. Já conviveu com pessoas que viveram isso e eventualmente até acompanha isso também. Né tenta na medida do possível na nossa empresa. Eh fazer um ambiente que seja o mais propício e mais adequado para as pessoas que trabalham conosco e também para a gente, né, Vinícius, é uma questão do nossa valores.

(84:49) Inclusive quando a gente fundou a Brown Pipe esse era um dos valores que a gente gostaria de >> faz parte do sujeitos que o pessoal negócio de falar. >> É, é, mas assim o por que que isso é importante? Por que a gente está falando sobre isso aqui? A gente falou lá no 390. É que isso vai influenciar também a forma como os gestores lidam com segurança da informação.

(85:13) Porque isso vai começar a ser mapeado agora também. Então é um aspecto psicológico da segurança que por força dessa atualização da NR vai precisar ser endereçado. Por último, Vinícius Serafim, nós temos aqui. >> Sim, Guilherme Goulart. A questão do analfabetismo funcional >> eh, e a relação com a vulnerabilidade digital do INAF. Né >> e também sobre como a gente vai lidar com IA.

(85:45) Esse é um tema que não somente a gente fala aqui no Segurança Legal, mas nas nossas conversas, né, Vinícius, quando a gente está ali conversando, enfim, é uma coisa que sempre volta na verdade. E eu acho que o grande. A grande questão é como é que a gente vai habilitar as pessoas em um cenário de Brasil aí que 65% da população estaria em níveis limitados ali de alfabetização.

(86:12) Como é que a gente vai entregar IA ou fazer com que essas pessoas usem de forma produtiva? Porque vão usar. Não adianta. Não tem mais como voltar atrás. É uma luta assim, né? >> Enfim, mas esse foi um problema que a gente falou lá no episódio 393, né, Vinícius? Você tem é, Guilherme. Assim eu nem digo uma luta de voltar atrás. Eu não tenho intenção de voltar atrás no uso da IA.

(86:42) O que me preocupa é que a IA afeta as pessoas de várias formas, né? >> Então a primeira que a gente já comentou inclusive nesse episódio aqui >> é a questão do próprio aprendizado. E então o pessoal delegando tarefas que eles deveriam fazer para aprender uma determinada área. Uma determinada área do conhecimento. A aprender vocabulário. Com se tu para vocabulário tu precisa.

(87:11) Para pensar tu precisa de vocabulário, tá? Eh é muito importante. Tu precisa dos conceitos que as palavras representam e tu usa as palavras como ferramentas para pensar, para refletir. Então se tu não tem um vocabulário um bom vocabulário tu tem dificuldade para pensar, para estruturar o teu raciocínio, tá?

(87:31) Então esse é um primeiro ponto. Ah a IA para funcionar bem, para tirar coisas realmente interessantes dela, tu precisa entender o que tu está fazendo. Pelo menos por enquanto, tu ainda precisa entender o que tu está fazendo. Entender muito bem. Entender os conceitos da tua área. Pegar os problemas. Eh organizar os problemas, né? Conseguir fazer as generalizações que um do necessário.

(88:07) Né tu conseguir extrair de uma situação concreta as regras para um funcionamento daquilo. Tem várias coisas. Tem o pensamento computacional que entra aí que é bem interessante. É bem importante saber para usar IA. E então tu tu tens pessoas e empresas utilizando a IA assim espremendo ela no que ela tem de melhor.

(88:25) >> Não só para matar trabalho, né? Não para matar trabalho, mas para fazer realmente o seu trabalho melhor. >> E ao mesmo tempo tem pessoas. E é a maior parte do uso, né? Aquele uso bem preguiçoso que tu chama. Abre aí. Larga uma pergunta lá e ela te responde tudo aqui. Faça um trabalho para mim. Não sei o resolve isso aqui para mim. Escreve não sei o quê, tá?

(88:53) Então assim a gente sabe o que é o resultado disso. São coisas de péssima qualidade >> e que as pessoas nem sabem. Tu pergunta para ela o que que ela quis dizer ali e ela não sabe o que ela fez porque ela não fez. Ela literalmente não fez. Ela só escreveu um prompt lá. Não nem se deu trabalho de estudar aquilo que a gerou.

(89:26) Então essa é a isso vai criar. A gente vai ter pessoas que vão ser muito hábeis para resolver problemas nas mais diversas áreas usando a IA. E tu vai ter pessoas que vão ser ainda mais incapazes de entender o que elas estão fazendo. E essas >> e por consequência, cada vez mais dependentes ou cada vez mais fácil, manipuláveis total e facilmente substituíveis. Porque uma pessoa que só sabe fazer isso usando IA.

(90:02) Eu não preciso dela na empresa. Eu uso IA >> e eu pego a IA e dou para. Em vez de contratar 100, eu contrato 20 mais capazes que saibam usar IA. Então esse é uma das coisas que eu não estou dizendo que isso é bom ou que é ruim. Eu não estou fazendo nenhum juízo de valor aqui. Mas estou colocando aquilo que me parece que existe uma certa concordância a quando a gente pega pessoas sérias falando de IA no mundo, tá?

(90:42) Eh, então o próprio Itam Molic, de novo, gente, eu recomendo fortemente aí para quem está na faculdade, quem está na escola, no ensino médio aí e tal, para os profissionais, fortemente que vocês comprem e leiam o livro “Com Inteligência” do Itam Molic, tá? A gente não tem cupom de desconto infelizmente. Mas o livro é muito bom, tá?

(91:14) E então assim é esse é o problema que eu vejo, tá, Guilherme? É aí que está. Nós vamos ter uma galera aí que vai ficar passada nesse negócio de ah, porque ela não vai desenvolver direito o as habilidades que ela precisa para atuar numa dada área. Ela não vai desenvolver direito sequer a questão de organizar o raciocínio para problemas gerais, independente de uma área específica.

(91:39) E essa turma vai ser muito facilmente substituída pela IA que a gente tem hoje. >> E não vai aprender, né? Porque assim você tem >> você tem áreas que são mais ou menos afetadas pela IA e as áreas são afetadas de formas muito diferentes, né? A gente conversava dia desse sobre IA e contabilidade, né? Que é um tema achei fascinante, né? As possibilidades aí envolvidas.

(92:08) Eh, mas ao mesmo tempo você tem lá o dentista, né? Eh o dentista vai poder usar IA. Por exemplo para interpretar um exame, uma radiografia. Para ideia para ver uma. Já existe há bastante tempo, inclusive >> para guiar um procedimento no sentido. Ah, o que que eu faço quando eu tenho esse problema clínico aqui? Então você segue. Esse é aquele tratamento.

(92:35) Mas em última análise você ainda vai estar botando a mão e abrindo o corpo humano, mexendo no corpo humano. O cara vai ter que aprender a fazer isso, né? Quanto não forem robôs fazendo isso. Robôs fazendo isso. É, tem robô fazendo cirurgia. É um troço assim que é acessível para >> Sim, sim. Sim, sim, né?